Blocos de conteúdo principal

Curso: Introdução à análise de dados on-line na pesquisa em Comunicação | ABERTO | | USP Extensão

-

Boas-vindas a você que começa o curso Introdução à Análise de Dados On-Line na Pesquisa em Comunicação. A preocupação central é formar pessoas com interesse em realizar pesquisas na internet.

Há duas formas de oferta. Em turmas de indivíduos matriculados e outra livre, autoinstrucional. Apenas a primeira oferecerá a certificação. A metodologia do curso, baseada na aprendizagem social, enfatiza a interação ativa com o ambiente e com as demais pessoas, de modo a fortalecer o desenvolvimento de uma atitude investigativa.

O curso possui sete módulos, cada um com duas atividades, além de um trabalho conclusivo. Os dois primeiros módulos oferecem um enquadramento geral da discussão. Os quatro módulos seguintes possuem atividades que se voltam aos interesses de cada um. O último módulo discute a questão da ética na pesquisa com dados digitais.

A proposta geral é que você realize reflexões e práticas que o capacitem a entender o papel dos dados digitais numa investigação.

Bons estudos.

Informado por pressupostos da pedagogia social, como a centralidade nos processos educativos do aprender a ser, o curso tem o objetivo de introduzir quem participa em discussões e práticas que envolvem o uso de dados on-line na pesquisa social, particularmente no campo da comunicação. No vídeo acima, é feita uma breve exposição sobre o conteúdo e o desenvolvimento dos trabalhos para a realização do curso. Você pode ver a página com Perguntas Frequentes [FAQ], o Código de Conduta, ter acesso ao PDF com a íntegra do curso e consultar todas as Referências do curso.

-

Módulo 1

Pesquisa e métodos digitais

-

Objetivos de aprendizagem:

- Entender a relevância da internet na pesquisa social

- Familiarizar-se com as discussões sobre a pesquisa na internet e os métodos digitais

- Verificar o uso de métodos digitais em pesquisas científicas

-

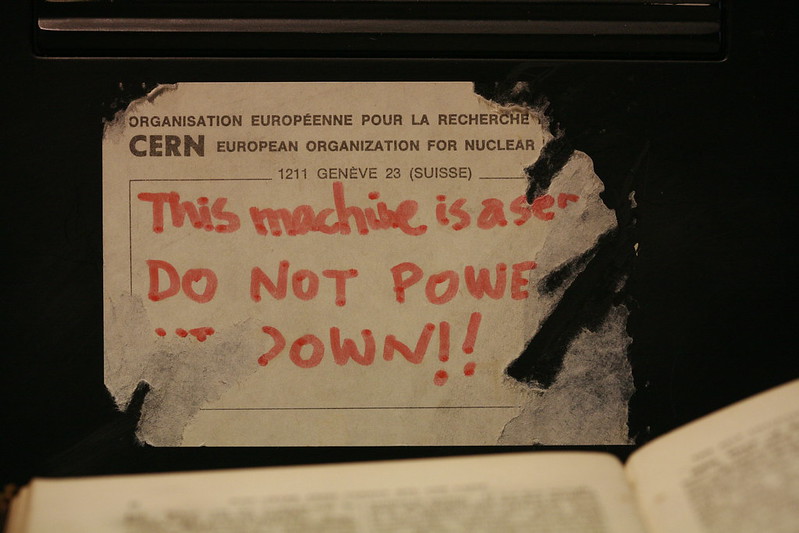

A pesquisa na sociedade em rede

Os computadores e a internet na pesquisa já não são novidades. Iniciantes no mundo acadêmico mal podem imaginar a época em que teses eram redigidas em máquinas de escrever ou quando, em um mundo sem bases de dados digitais conectadas, ferramentas de busca de literatura científica e livrarias on-line, as revisões de literatura podiam exigir meses de trabalho. Houve um tempo em que as submissões de artigos a revistas e congressos eram feitas pelo correio e foi um avanço quando, em vez de textos impressos, eram enviados disquetes. Dispositivo que muitos, hoje, nunca viram.

As mudanças no modo de vida das sociedades, decorrentes da rápida inserção de tecnologias digitais, desde meados da década de 1990, ocorrem não somente no campo da investigação científica, mas em todas as dimensões. Daí, a criação de termos para nomear o atual momento histórico caracterizado pela emergência de uma sociedade global interconectada por redes de informação, como o de sociedade em rede.

Entretanto, como as ciências sociais sempre tiveram como objeto a realidade de seu tempo, sendo admitido que seu surgimento decorre das transformações da primeira revolução industrial, elas são, ao mesmo tempo, afetadas pelas transformações, internamente em seu modo de trabalho, e convocadas para compreender as mudanças na sociedade.

É provável que você que está iniciando esse curso já tenha ou esteja desenvolvendo alguma pergunta de pesquisa que possa estar relacionada ao universo da internet. Como pretende realizar a pesquisa, que dados utilizará?

Embora você já tenha falado sobre suas expectativas no Fórum inicial, responda à enquete a seguir, na qual poderá ver o conjunto de respostas da turma.

-

A mídia digital como objeto de pesquisa

No contexto social mencionado, teorias e categorias sociológicas tradicionais precisam ser reinterpretadas ou expandidas para incluir o impacto da internet. Há o debate sobre a emergência da ciência social digitalizada ou da sociologia digital. A discussão ocorre em várias disciplinas, com propostas de especialidades voltadas ao digital (e.g., “história digital”) ou para a organização do modo de produção de conhecimento de maneira mais geral. Isso poderia ocorrer, por exemplo, por meio da pesquisa em campos interdisciplinares, como o das “humanidades digitais”.

Outros autores defendem o estudo do papel da mídia digital na sociedade como um tópico relevante de pesquisa, mas não como nova disciplina ou campo inter, multi ou transdisciplinar. O problema apontado é a hiperfragmentação do mundo acadêmico em subcampos e subdisciplinas cada vez mais especializados, promovendo uma diversidade sem unidade.

Seja como for, a pesquisa social já tem contribuído para aumentar a compreensão e desmistificar as práticas digitais. Desse modo, assim como a novidade da internet se esvaiu, também o folclore, por vezes divertido, sobre ela foi superado por conhecimentos mais rigorosos. Um exemplo é o da preocupação sobre a suposta ampla falsificação de identidades que a rede fomentaria, com animais se passando por pessoas.

O contínuo imbricamento entre o mundo virtual e o off-line reforçou a importância social da internet, que é cada vez mais utilizada pelas pessoas. Desse modo, é possível indagar:

“Existe uma distinção útil entre a vida social on-line e os mundos sociais da ‘vida real’? Cada vez mais, a resposta parece ser não. As duas se mesclaram em um mundo: o mundo da vida real, como as pessoas o vivem. É um mundo que inclui o uso da tecnologia para se comunicar, debater, socializar, expressar e compreender”.Embora essa convergência seja discutível, ela constitui, por si só, um tema de pesquisa em relação a diferentes situações e objetos de investigação. Em sentido mais geral, as questões de conhecimento que envolvem a internet foram amplamente expandidas. A discussão sobre os dados on-line ou dados digitais e o uso deles associados aos métodos digitais decorre desse cenário.

Introdução à Análise de Dados On-Line na Pesquisa em Comunicação

Internet e identidades

O meme acima é um dos que foi inspirado pelo cartum, hoje clássico, de Peter Steiner, publicado em 1993, quando a questão das identidades on-line era um tema de questionamento.

-

Pesquisa on-line e métodos digitais/virtuais

O termo pesquisa on-line (online research) é corrente na literatura de língua inglesa e seu uso está relacionado ao uso da internet em investigações. Isso começou a ocorrer desde que a web se tornou pública, sendo comum, nos debates da época, a distinção entre a pesquisa que examina a internet e a que utiliza a pesquisa on-line. A ideia de métodos on-line ou digitais se aplica à última noção, ainda que tais métodos sejam naturalmente mais utilizados quando os fenômenos em estudo estão associados à rede.

Apesar de não existir consenso a respeito do que são métodos digitais (digital methods), é possível delinear dois entendimentos principais: um geral ou amplo e outro específico, mais restrito. No primeiro caso, o termo indica o

“uso de tecnologias on-line e digitais para coletar e analisar dados de pesquisa ... [envolvendo] não apenas a pesquisa que explora fenômenos on-line, mas também com interesse mais amplo na utilização de métodos digitais para abordar todos os aspectos da vida social contemporânea”.Nessa perspectiva, o “digital” na expressão é utilizado como um termo genérico para descrever métodos de pesquisa que empregam aplicativos e procedimentos computacionais. É comum, a partir desse entendimento, que se discuta a transposição de métodos tradicionais das ciências sociais para o digital, entre outros, os levantamentos (surveys), entrevistas e grupos focais, etnografias e experimentos.

Por vezes, para diferenciar essa abordagem daquela que veremos a seguir, fala-se em métodos virtuais com respeito a esse entendimento ampliado sobre métodos digitais.

-

Métodos digitais em sentido estrito

O entendimento restrito sobre métodos digitais é baseado nas propostas de Richard Rogers (2013), que delimita o domínio deles às pesquisas que utilizam, primariamente, dados da própria internet, procurando refletir sobre eles e “seguir o método do meio”.

Isso significa levar em consideração as especificidades da mídia digital investigada: estudar a sociedade a partir da investigação de um dispositivo, aplicativo ou plataforma digital implica, também, estudar essas instâncias. Em síntese, essa abordagem metodológica emprega ferramentas e objetos digitais para investigar os traços da vida social que emergem das interações on-line.A adesão aos postulados teóricos de cada proposta, bem como os problemas e questões de pesquisa ao qual alguém irá se dirigir são os fatores que geralmente presidem a escolha ou ênfase em determinada concepção.

De fato, os entendimentos expostos sobre os métodos digitais não são incompatíveis. Uma pessoa com uma concepção mais ampla sobre o tema pode julgar relevante entender como os dados de mídia digital que utiliza podem ser afetados por processos técnicos. Em contrapartida, outra que estude uma plataforma a partir de dados internos a ela poderá optar por complementar seu estudo com entrevistas on-line.

A divisão dual da pesquisa com métodos digitais é, em certa medida, uma estratégia de exposição didática, porém, é possível perceber e refletir sobre como investigações envolvendo a internet podem aderir mais a uma ou outra abordagem. A atividade a seguir, de encerramento do Módulo, propõe que você faça isso.

Antes disso, veja, no próximo tópico, a linha do tempo sobre o desenvolvimento de tecnologias, os impactos sociais da internet e a pesquisa on-line.

-

Internet, pesquisa e sociedade

-

Os estudantes devemReceber uma nota

Faça os exercícios para recapitular o que estudou.

-

REAs de aprofundamento

-